- NVIDIA chính thức phát hành phiên bản Portal: Prelude RTX trên Steam

- CEO NVIDIA giới thiệu các nền tảng AI sinh trắc học dùng cho mọi ngành công nghiệp

- Các nhà sản xuất điện tử hàng đầu thế giới áp dụng công nghệ NVIDIA Generative AI và Omniverse để số hóa các nhà máy tiên tiến

- MediaTek bắt tay cùng NVIDIA phát triển toàn diện sản phẩm cho ngành công nghiệp ô-tô

CEO NVIDIA Jensen Huang đã có màn thuyết trình ấn tượng chia sẻ về những cải tiến mới cho các nền tảng AI từ phần cứng với dòng GPU, hệ thống siêu máy tính thế hệ mới đến các nền tảng công nghệ đám mây tại Hội nghị Đồ họa Máy tính SIGGRAPH 2023 được diễn ra từ ngày 6 đến 10/8/2023 tại Los Angeles (Mỹ).

Generative AI là một trong những chủ đề hàng đầu mà NVIDIA tập trung giới thiệu tại Hội nghị Đồ họa Máy tính SIGGRAPH 2023. CEO của hãng đã giới thiệu một loạt những cải tiến trên các phiên bản mới nhất của dịch vụ đào tạo AI Hugging Face với siêu máy tính AI NVIDIA DGX Cloud, NVIDIA AI Enterprise 4.0 và bộ công cụ AI Workbench.

Các máy trạm RTX và GPU thế hệ mới hỗ trợ cho Generative AI

Các sản phẩm phần cứng dành cho Generative AI là nội dung được CEO NVIDIA giới thiệu trong phần thuyết trình của mình tại Hội nghị SIGGRAPH 2023. Ông đã giới thiệu dòng máy trạm RTX mới với GPU RTX 6000 và phần mềm doanh nghiệp hỗ trợ AI tích hợp. Sản phẩm được hãng thiết kế và sản xuất nhầm đáp ứng yêu cầu sức mạnh GPU lớn cần thiết cho việc kỹ thuật số hóa công nghiệp hoặc trực quan 3D của doanh nghiệp.

CEO NVIDIA đồng thời chia sẽ về kiến trúc mới cho các máy chủ OVX. Các máy chủ này được xây dụng với 8 GPU Ada L40S mỗi cái và cũng tương thích với phần mềm AI Enterprise. Tất cả các máy trạm này phù hợp cho việc tạo nội dung như hình ảnh được tạo bởi AI cho thiết kế đồ họa, hoạt hình hoặc kiến trúc.

|

‘Superchip’ với bộ xử lý HBM3e hỗ trợ phát triển AI

Phiên bản tiếp theo trong dòng sản phẩm Grace Hopper sẽ là GH200 được xây dựng trên một 'superchip' Grace Hopper. Nó bao gồm một máy chủ duy nhất với 144 nhân Arm Neoverse, có khả năng tính toán lên đến 8 petaflops và bộ nhớ HBM3e 282 GB. Bộ nhớ HBM3e cung cấp băng thông 10 TB/giây, nhanh hơn gấp 3 lần so với thế hệ HBM3.

Ông Jensen Huang, Nhà sáng lập kiêm CEO của NVIDIA, chia sẻ: "Nền tảng Superchip Grace Hopper GH200 mới cung cấp điều này với công nghệ bộ nhớ và băng thông ngoại lệ để cải thiện lưu lượng xử lý, khả năng kết nối GPU để tổng hợp hiệu suất mà không cần phải gi comprom n, và thiết kế máy chủ có thể triển khai dễ dàng trên toàn bộ trung tâm dữ liệu."

Siêu máy tính AI NVIDIA DGX Cloud được cung cấp bởi Hugging Face

Siêu máy tính AI DGX Cloud của NVIDIA bây giờ sẽ có sẵn thông qua nhà cung cấp giải pháp AI - Hugging Face cung cấp dịch vụ cho những người muốn đào tạo và điều chỉnh mô hình Generative AI. Các tổ chức muốn sử dụng Generative AI cho công việc cụ thể thường cần đào tạo nó trên dữ liệu riêng của họ, đó là quy trình có thể yêu cầu rất nhiều băng thông. DGX Cloud bao gồm NVIDIA Networking và 8 nhân GPU Tensor H100 hoặc A100 80 GB của NVIDIA với tổng cộng 640 GB bộ nhớ GPU cho mỗi nút.

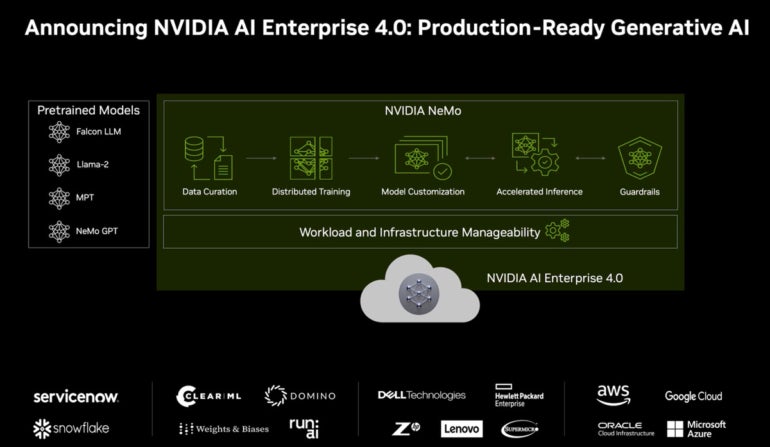

Ra mắt AI Enterprise 4.0 và NVIDIA AI Workbench

AI Enterprise của NVIDIA, một bộ phần mềm AI và phân tích dữ liệu để xây dựng các giải pháp generative AI, sẽ sớm chuyển sang phiên bản 4.0. Thay đổi lớn trong phiên bản này là việc thêm NeMo, một nền tảng cho việc tạo ra các công cụ tùy chỉnh tạo lập, đào tạo, suy luận, các rào cản và nhiều tính năng khác cho Generative AI. NeMo mang đến một khung nhẫn mạng dành cho việc xây dựng và triển khai các ứng dụng doanh nghiệp sử dụng các mô hình ngôn ngữ lớn. Phiên bản 4.0 của công nghệ AI dành cho đồ họa này đã được tích hợp vào các dịch vụ của các nhà cung cấp dịch vụ học máy (Machine Learning) như ClearML, Domino Data Lab, Run:AI và Weights & Biases.

|

Hãng cũng đồng thời ra mắt dịch vụ NVIDIA AI Workbench tích hợp công nghệ AI Enterpirse 4.0, một không gian làm việc được thiết kế để làm cho việc khởi động các ứng dụng AI trên máy tính cá nhân hoặc máy trạm tại nhà dễ dàng và đơn giản hơn. Với AI Workbench, các dự án có thể dễ dàng di chuyển giữa các máy tính cá nhân, trung tâm dữ liệu, đám mây công cộng và DGX Cloud của NVIDIA.

Trước hết, nhà phát triển có thể đưa tất cả các mô hình, khung làm việc, SDK và thư viện từ các kho lưu trữ mã nguồn mở và nền tảng AI của NVIDIA vào một không gian. Sau đó, họ có thể khởi đầu, thử nghiệm và điều chỉnh các sản phẩm AI mà họ tạo ra trên máy tính cá nhân hoặc máy trạm RTX. Họ cũng có thể mở rộng lên máy chủ dữ liệu và lưu trữ đám mây nếu cần.

NVIDIA AI Workbench sẽ chính thức được phát hành vào Mùa Thu năm 2023 và được cung cấp miễn phí như một phần của các đăng ký sản phẩm khác, bao gồm AI Enterprise.

Cập nhật nhiều tính năng mới cho Omniverse với sự hợp tác cùng OpenUSD

Cuối cùng, NVIDIA đã chi tiết về các cập nhật cho Omniverse, một nền tảng phát triển để kết nối, xây dựng và vận hành các ứng dụng kỹ thuật số trong công nghiệp với tiêu chuẩn trực quan 3D OpenUSD. Omniverse có ứng dụng trong hoạt hình 3D và phát triển trò chơi cũng như trong sản xuất ô tô. Nhiều cập nhật mới liên quan đến sự hợp tác mới của NVIDIA với Universal Scene Description, một định dạng mã nguồn mở để tạo đối tượng và các yếu tố khác trong đồ họa 3D. Tiêu biểu như ứng dụng tạo hình ảnh AI của Adobe, Firefly. Phiên bản mới nhất của Omniverse hiện đang trong giai đoạn beta và sẽ sớm cung cấp cho các khách hàng Doanh nghiệp Omniverse.

Nguồn: Techrepublic

Thiên An